Python Requests ライブラリとは?

回答

PythonのRequestsライブラリは、GET、POST、PUT、DELETEなどのウェブリクエストを簡潔で読みやすい方法で送信するために使用されるサードパーティのHTTPクライアントです。これは低レベルのネットワーキングの複雑さを抽象化し、APIとの対話、ウェブデータの取得、Pythonでの自動化やスクリーピングワークフローの構築をより簡単にします。

詳細な説明

RequestsライブラリはHTTP通信の上位レベルのラッパーとして機能し、ソケットやクエリエンコードを手動で処理することなく、ウェブサーバーと対話できるようにします。複雑なネットワーキングコードを扱う代わりに、ユーザーはrequests.get()やrequests.post()などの直感的な関数を呼び出すことができます。

裏では、接続プール、クッキー、SSL検証、ヘッダー、レスポンスの解析を管理します。これは特に、クライアントとサーバー間で構造化されたデータ(例: JSON)を交換するREST APIとの統合において役立ちます。エラー処理も簡単になり、ステータスコードやレスポンスコンテンツへのアクセスが容易になります。

多くの現代のウェブサイトはセキュリティ管理システムや動的な保護レイヤーを使用しているため、HTTPリクエストが場合によってはブロックされるか、検証を求められることがあります。このような状況では、開発者はRequestsを進んだプロキシ管理や自動キャプチャ解決ソリューション(例: CapSolver)と組み合わせて、大規模なスクリーピングや自動化タスク中に信頼性のあるアクセスを維持することがよくあります。

解決策 / 方法

- 基本的なHTTPリクエスト: GETやPOSTなどの組み込みメソッドを使用して、ウェブサーバーにデータを取得または送信します。これはAPIや単純なスクリーピングタスクに適しています。

- セッションとヘッダー管理: 持続的なセッション、カスタムヘッダー、認証トークンを使用して、実際のブラウザの動作をシミュレートし、リクエストの信頼性を向上させます。

- セキュリティ保護の処理: リクエストがキャプチャやセキュリティ管理システムによってブロックされた場合、検証チャレンジを処理し、データ収集ワークフローを途切れなく保つために、自動解決ソリューション(例: CapSolver)を統合します。

最適な実践 / ヒント

適切なタイムアウトを設定して、リクエストがフリーズしないようにし、User-Agentなどのヘッダーを変更して互換性を向上させ、パフォーマンス最適化のためにセッションを再利用してください。大規模なスクリーピングを行う場合、プロキシとリトライ戦略と組み合わせて使用することで、失敗率を減らし、安定性を向上させることができます。

👉 関連:

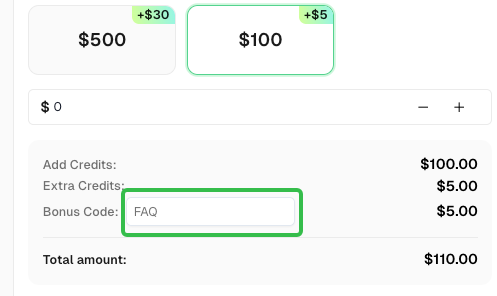

CapSolverで登録する際、コード

FAQを使用して、追加の5%のボーナスをチャージに追加してください。

CapSolver FAQ — capsolver.com